Bundesnetzagentur übernimmt KI Aufsicht

Was du jetzt wissen solltest

Veröffentlicht am 03.03.2026

KI-Snack mit Inga | KI Aufsicht in Deutschland

Die Bundesnetzagentur ist jetzt Aufsichtsbehörde

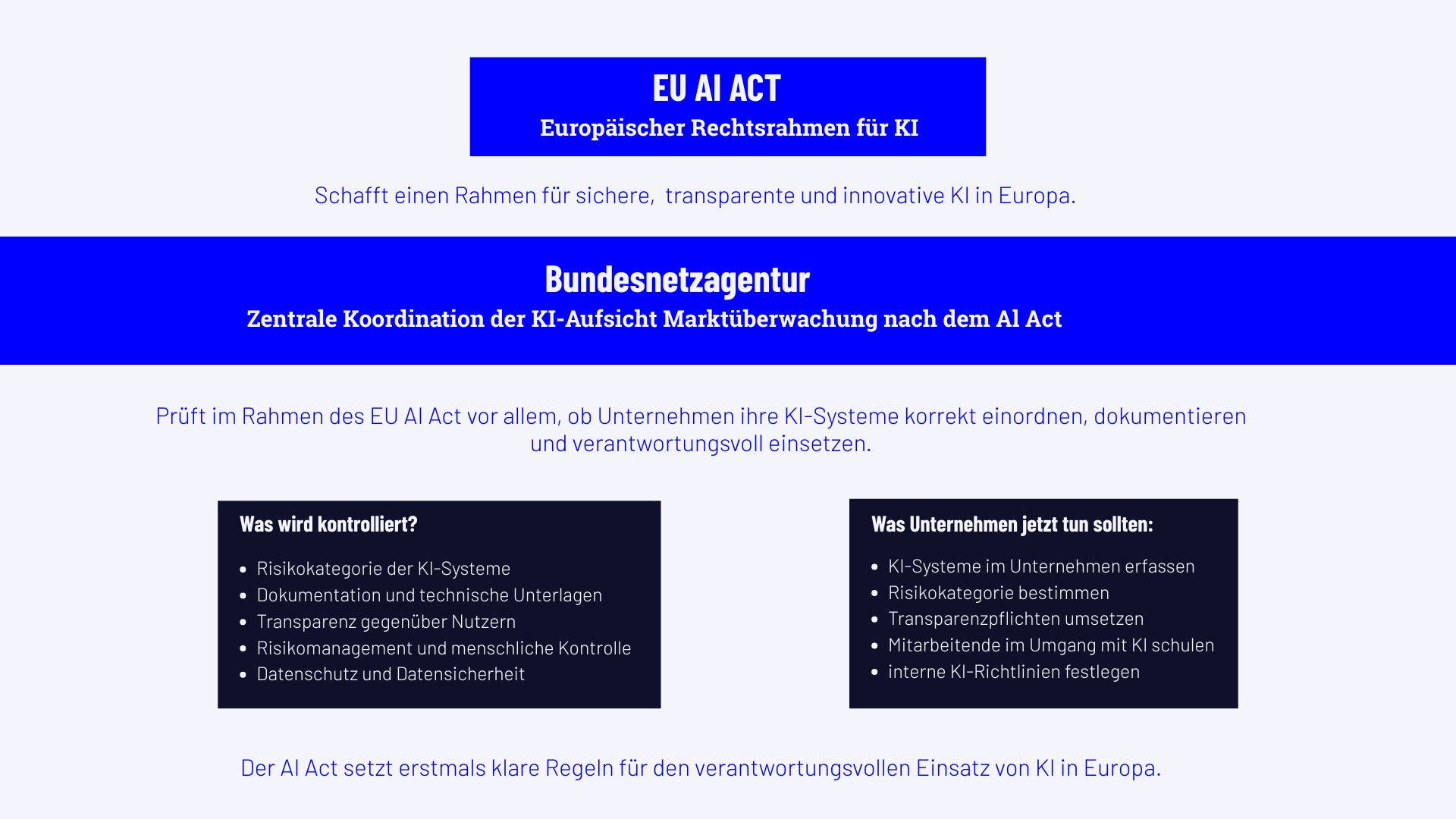

Die Entscheidung war im politischen Berlin bereits erwartet worden: Die Bundesregierung will die Bundesnetzagentur zur zentralen Aufsichtsbehörde für KI-Anwendungen nach dem europäischen AI Act machen. Mit dem geplanten KI-Marktüberwachungs- und Innovationsförderungsgesetz (KI-MIG) soll sie künftig als koordinierende Stelle fungieren und die Marktüberwachung in Deutschland bündeln.

Warum die Bundesnetzagentur?

Die Wahl überrascht wenig. Die Behörde verfügt über Erfahrung in der Regulierung komplexer, technologiegetriebener Märkte – etwa im Telekommunikations-, Energie- und Plattformbereich. Zudem ist sie bereits in europäische Regulierungsnetzwerke eingebunden. Ziel ist eine zentrale Anlaufstelle für Unternehmen, statt eines Flickenteppichs unterschiedlicher Behörden.

Gleichzeitig bleibt es beim sogenannten „One-Stop-Shop mit Fachaufsicht“: In regulierten Branchen behalten spezialisierte Behörden ihre Zuständigkeit – etwa die BaFin im Finanzsektor oder Datenschutzbehörden bei DSGVO-Fragen. Die Bundesnetzagentur übernimmt die Koordination und Marktüberwachung im Sinne des AI Act.

Ab wann wird kontrolliert?

Der AI Act ist seit August 2024 in Kraft. Die Pflichten greifen jedoch gestaffelt:

- Ab 2025: Erste Verbote (z. B. bestimmte biometrische Echtzeitüberwachung) und Anforderungen an Hochrisiko-Systeme beginnen wirksam zu werden.

- 2026: Die meisten regulatorischen Verpflichtungen gelten vollständig, inklusive umfassender Marktüberwachung und Sanktionsmöglichkeiten.

Die nationale Aufsichtsstruktur muss bis dahin operativ arbeitsfähig sein. Unternehmen sollten daher nicht davon ausgehen, dass Kontrollen erst „irgendwann später“ beginnen.

Wie wird kontrolliert?

Die Marktüberwachung orientiert sich an klassischen EU-Produktsicherheitsmechanismen. Das bedeutet:

- Prüfung von Dokumentationen

- Anforderung technischer Unterlagen

- Stichprobenkontrollen

- Anordnungen zur Nachbesserung

- Vertriebsverbote bei schweren Verstößen

- Bußgelder (bis zu 35 Mio. Euro oder 7 % des weltweiten Jahresumsatzes)

Besonders bei Hochrisiko-KI werden Behörden systematisch prüfen, ob Risikomanagement, Transparenz- und Dokumentationspflichten eingehalten werden.

Empfehlungen für den sicheren Einsatz von KI

Wer KI professionell einsetzt oder anbietet, sollte jetzt strukturiert vorgehen:

1. Interne KI-Inventarliste führen

Erstelle ein zentrales Register aller eingesetzten KI-Systeme:

- Zweck der Anwendung

- Anbieter

- Datenarten (personenbezogen?)

- Risikokategorie nach AI Act

- Zuständiger Verantwortlicher im Unternehmen

Das ist die Basis für jede Compliance-Prüfung.

2. Risikoklassifizierung dokumentieren

Bewerte systematisch, ob es sich um:

- minimales Risiko

- begrenztes Risiko

- Hochrisiko-KI

- oder unzulässige KI handelt

Diese Bewertung sollte nachvollziehbar dokumentiert sein.

3. Schulungspflichten ernst nehmen

Mitarbeitende, die mit KI arbeiten oder Entscheidungen darauf stützen, müssen geschult werden:

- Funktionsweise und Grenzen der Systeme

- Bias- und Diskriminierungsrisiken

- Dokumentationspflichten

- menschliche Kontrollmechanismen

Das reduziert Haftungsrisiken erheblich.

4. Transparenz sicherstellen

- Kennzeichne KI-generierte Inhalte klar

- Informiere Nutzer, wenn sie mit KI interagieren

- Offenlege automatisierte Entscheidungsprozesse, sofern relevant

5. Vertragsprüfung mit Anbietern

Bei externen KI-Tools:

- Wer ist Anbieter im Sinne des AI Act?

- Wer trägt welche Compliance-Verantwortung?

- Gibt es Dokumentation, Risikobewertung, Konformitätserklärung?

Gerade bei SaaS-Lösungen ist die Rollenverteilung entscheidend.

6. Governance-Struktur aufbauen

Empfehlenswert ist eine interne KI-Policy mit:

- Freigabeprozessen

- Prüfmechanismen

- Zuständigkeiten

- Eskalationswegen

Größere Unternehmen sollten ein KI-Compliance-Board oder eine verantwortliche Stelle benennen.

Einordnung

Für reine Content-Nutzung von KI bleibt das Risiko überschaubar.

Für HR, Finanzentscheidungen, Medizin, Scoring oder automatisierte Bewertungssysteme wird es dagegen regulatorisch ernst.

Die Aufsicht wird nicht mit Massenrazzien starten. Aber sie wird dort ansetzen, wo:

- Grundrechte betroffen sind

- wirtschaftliche Risiken entstehen

- Beschwerden eingehen

oder Marktteilnehmer auffällig werden.

Kommentar & Meinung:

Ok, die KI-VO ist sicher kein Bestseller, mit dem man sich freiwillig bei Kaffee und Croissant aufs Sofa setzt. Sinnvoll finde ich die Regulierung von KI trotzdem.

KI kann ein enormer Produktivitäts-Turbo sein. Genau deshalb braucht ihr Einsatz aber klare Regeln. Denn in vielen Unternehmen wird KI längst genutzt, ohne dass sauber definiert ist, wer sie wofür einsetzen darf, welche Daten verarbeitet werden dürfen und wo besondere Risiken liegen. Gerade dann wird es kritisch — etwa wenn mit sensiblen Kunden-, Unternehmens- oder Personaldaten gearbeitet wird.

Aus meiner Sicht liegt hier eines der größten Risiken im Unternehmensalltag: nicht in der Technologie selbst, sondern in ihrem unkoordinierten Einsatz. Wenn Mitarbeitende KI-Tools ohne Schulung, ohne Leitplanken und ohne klare Prozesse nutzen, entstehen schnell Fehler, Unsicherheiten und im schlimmsten Fall echte Compliance-Probleme.

Gleichzeitig liegt genau hier auch ein riesiges Potenzial. Gut geschulte Mitarbeitende nutzen KI nicht nur sicherer, sondern meist auch deutlich gewinnbringender als bei einem rein sporadischen Einsatz. Wer versteht, wie man eine KI sinnvoll instruiert, starke Prompts entwickelt, Ergebnisse kritisch prüft oder eigene Assistenten oder sogar Agenten passend konfiguriert, kann Prozesse deutlich effizienter gestalten und die Qualität der Ergebnisse verbessern.

Deshalb sind aus meiner Sicht zwei Dinge besonders wichtig:

- Qualifizierung der Mitarbeitenden im Umgang mit KI

- klare Prozesse und Verantwortlichkeiten im Unternehmen

Idealerweise gibt es im Unternehmen eine Person oder ein kleines Team, das das Thema federführend koordiniert und eng mit den Fachabteilungen zusammenarbeitet. Manche Unternehmen gehen hier schon sehr klug vor — zum Beispiel mit internen Workshops, kleinen KI-Challenges oder der gezielten Prüfung, an welchen Stellen KI echte Effizienzgewinne bringt und wo besondere Vorsicht nötig ist.

KI kann enorme Chancen eröffnen — aber nur dann, wenn Know-how, klare Prozesse und Verantwortungsbewusstsein zusammenkommen.

✨ Goodie zum Thema: ✨ Checkliste KI-VO: Für einen kompakten Überblick zu den Anforderungen haben wir eine praktische Checkliste erstellt.

Quellen und weiterführende Links:

https://artificialintelligenceact.eu/

Factsheet für kleine und mittelständische Unternehmen und StartUps

https://www.heise.de/news/AI-Act-Bundesregierung-bringt-KI-Gesetz-auf-den-Weg-11173623.html

https://www.bundesnetzagentur.de/DE/Fachthemen/Digitales/KI/start_ki.html

Transparenzhinweis KI: KI unterstützt mich bei der Erstellung der KI Snacks. Die Inhalte basieren aber auf belastbaren Quellen, meinen Erfahrungen aus realen Projekten und auf Fragen, die mir Kunden zu bestimmten Themen immer wieder stellen. Am Ende steckt in jedem Beitrag ein hoher Eigenanteil.